کارشناسان در سراسر جهان به طور فزاینده ای نگران ابزارهای جدید هوش مصنوعی هستند که باعث میشود تصاویر و فیلمها را به راحتی ویرایش کنند – به ویژه با توجه به قدرت رسانههای اجتماعی برای به اشتراک گذاشتن به سرعت محتوای تکان دهنده و بدون بررسی واقعی. بعضی از این ابزار توسط Adobe ادغام شده است، اما این شرکت همچنین بر روی پادزهری در مورد نحوه استفاده از یادگیری ماشین برای شناسایی خودکار تصاویر ویرایش شده کار میکند.

آخرین کار این شرکت که در کنفرانس کامپیوتری CVPR نشان داده شده است، بیانگر این است که چگونه جرم یابی دیجیتالی توسط انسان میتواند در زمان کمتری با کمک ماشینهای اتوماتیک انجام شود. مقاله تحقیقی نشان دهنده یک پیشرفت بزرگ در این زمینه نیست و هنوز به عنوان یک محصول تجاری در دسترس نیست، اما جالب است که Adobe – که نامش مترادف با ویرایش تصویر است – علاقه مند به این خط کار است.

یک سخنگوی شرکت گفت که این یک پروژه تحقیقاتی در مرحله اولیه بوده، اما در آینده، این شرکت میخواهد در «توسعه فناوریهایی که به نظارت و تأیید صحت رسانههای دیجیتال کمک کند» نقش بسزایی ایفا کند. اینکه دقیقا ممکن است به چه معنی باشد هنوز روشن نیست، چرا که ادوبی هرگز تا قبل از این نرم افزار طراحی شده برای نشان دادن تصاویر جعلی را عرضه نکرده است. اما، شرکت به کار خود با مجریان قانون اشاره میکند (به عنوان مثال، به استفاده از جرم یابی قانونی دیجیتال برای کمک به یافتن کودکان گم شده) به عنوان شواهدی از نگرش مسئولانهی این شرکت نسبت به تکنولوژی آن است.

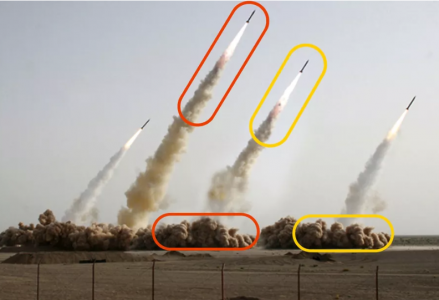

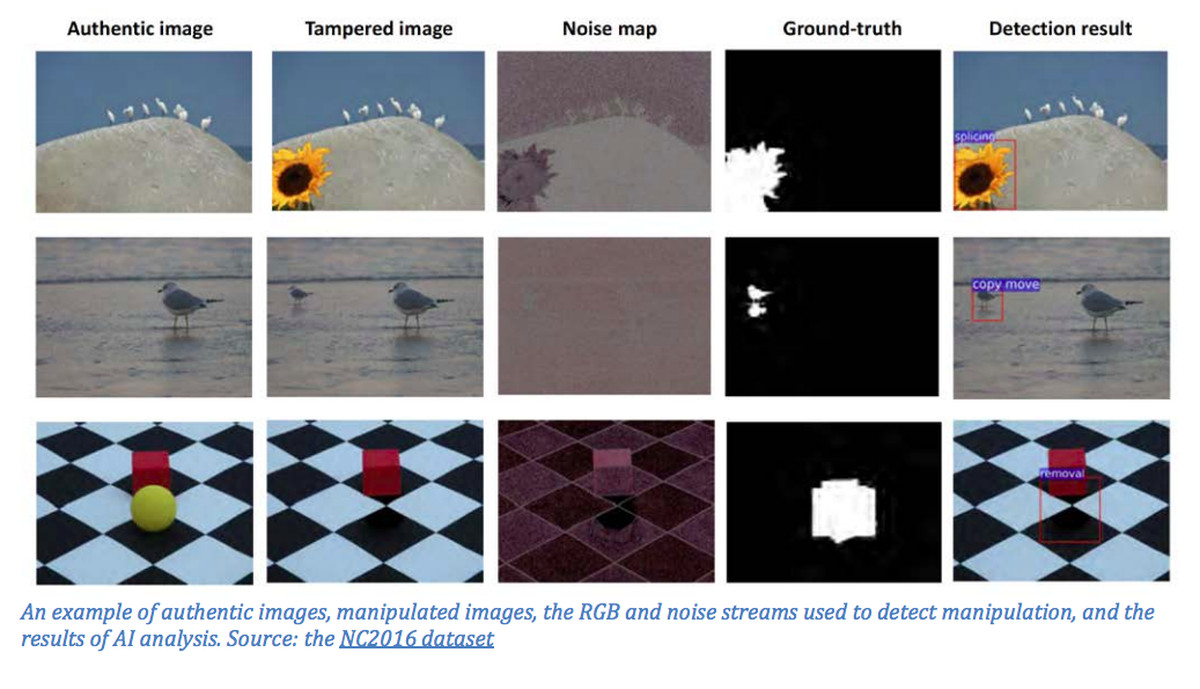

مقاله پژوهشی جدید نشان میدهد چگونه میتوان یادگیری ماشین را برای شناسایی سه نوع معمول از دستکاری تصویر مورد استفاده قرار داد، ترکیب : جایی که دو قسمت از تصاویر مختلف ترکیب میشوند؛ شبیه سازی، جایی که اشیاء درون یک تصویر کپی و جابهجا میشوند؛ و حذف، زمانی که یک شیء به طور کامل ویرایش میشود.

کارشناسان دیجیتال برای پیشگیری از این نوع دستکاری، معمولا در سرتاسر لایههای مخفی به دنبال سر نخهایی هستند. هنگامیکه این نوع ویرایشها ایجاد میشوند، آنها رد پاهای دیجیتال، مانند اختلافات در تغییرات تصادفی در رنگ و روشنایی ایجاد شده توسط سنسورهای تصویر (همچنین به عنوان نویز تصویر)، به جا میگذارند. برای مثال هنگامیکه شما دو تصویر مختلف را به هم متصل میکنید، ، یا یک شیء را از قسمتی از یک تصویر جدا کرده و در تصویر دیگری آن را جای گذاری میکنید، این شئ با نویز پس زمینه مطابقت ندارد، مانند یک لکه روی دیوار که با رنگ ترمیم شده است.

همانند بسیاری از دیگر سیستمهای یادگیری ماشینی، ادوبی با استفاده از یک مجموعه بزرگ از تصاویر ویرایش شده آموزش داده شده است. از این تصاویر، این هوش مصنوعی یاد گرفت که الگوهای مشترک که نشان دهنده دستکاری است را پیدا کند. در بعضی آزمونها نمرات بالاتری نسبت به سایر سیستمهای ساخته شده توسط سایر تیمها بدست آورد. با این حال، این تحقیق هیچ کاربرد مستقیمیدر تشخیص تقلب عمیق ندارد (نسلی جدید از ویدیوهای ویرایش شده با استفاده از هوش مصنوعی).

هانی فرید، متخصص جرم یابی دیجیتال به Verge گفت:

مزیت این روشهای جدید یادگیری ماشینی این است که آنها توانایی کشف مصنوعاتی را دارند که آشکار نیستند و قبلا شناخته نشدهاند. اشکال این روشها این است که آنها تنها به همان اندازه اطلاعات آموزش داده شده در شبکهها کارایی دارند و در حال حاضر حداقل احتمال کمتری برای یادگیری مصنوعات سطح بالا مانند ناسازگاری در هندسه سایهها و بازتابها وجود دارد.

با کنار گذاشتن این هشدارها، خوب است که تحقیقات بیشتر انجام شده تا بتواند به ما کمک کند تا تقلبهای دیجیتالی را به چالش بکشیم. اگر این صدای زنگ هشدار درست باشد و به نوعی در حال هدایت شدن به دنیای پس از حقیقت هستیم، ما به همه ابزارهایی نیاز داریم که بتوانیم واقعیت را از غیر واقعیت تشخیص دهیم. هوش مصنوعی میتواند صدمه بزند، اما میتواند به خوبی نیز کمک کند.

دیدگاه ها